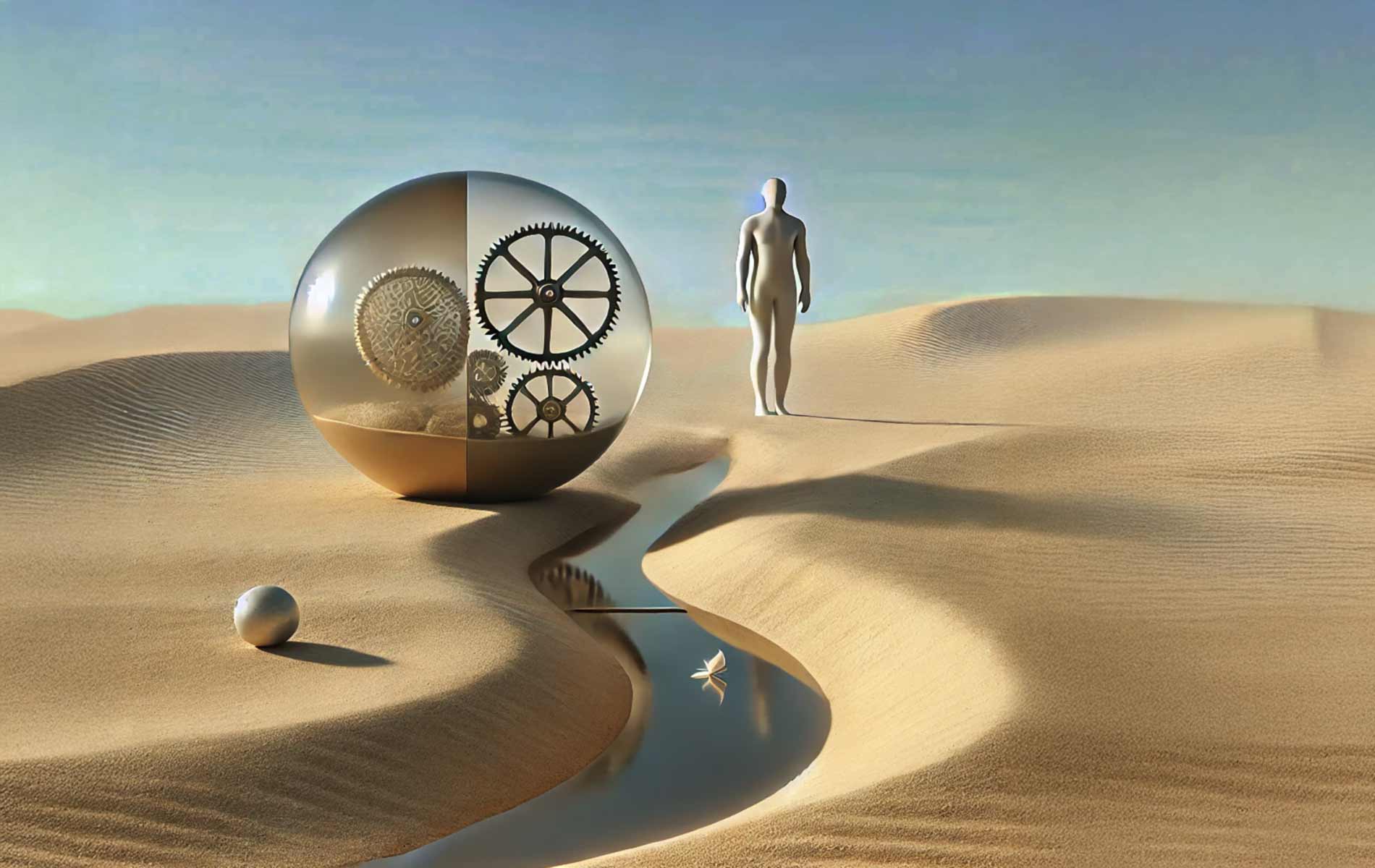

Künstliche Intelligenz und Intuition

Möglichkeiten und Grenzen algorithmischer Entscheidungsprozesse

In der aktuellen Debatte um die Rolle künstlicher Intelligenz (KI) in gesellschaftlichen, wirtschaftlichen und wissenschaftlichen Entscheidungsprozessen stellt sich zunehmend die Frage, inwiefern KI-Systeme fähig sind, menschliche Intuition zu simulieren oder gar zu ersetzen. Intuition wird in der wissenschaftlichen Literatur als eine Form der unbewussten, schnellen und oft zutreffenden Urteilsbildung beschrieben, die auf implizitem Erfahrungswissen, emotionaler Resonanz und situativer Einbettung basiert (vgl. Gigerenzer, 2007; Damasio, 1994). Dieses Text analysiert, welche Aspekte menschlicher Intuition durch KI-Modelle abgebildet werden können, und zeigt zugleich die Grenzen rein rechnerischer Entscheidungsprozesse auf.

Intuition als schnelle, unbewusste Informations-verarbeitung

Ein zentrales Merkmal der Intuition ist ihre Geschwindigkeit und Automatisierung. Daniel Kahneman (2012) beschreibt intuitive Prozesse als Teil des „System 1“ – einer schnellen, automatischen und wenig aufwändigen Denkweise. Diese Form der Informationsverarbeitung ist in KI-Systemen durchaus simulierbar. Durch Deep Learning oder heuristikbasierte Entscheidungsalgorithmen können Maschinen in Millisekunden Entscheidungen treffen, ohne explizit erklärbare Zwischenschritte zu dokumentieren.

Beispielsweise sind neuronale Netze in der Lage, Bildinformationen zu verarbeiten und Tumore in radiologischen Aufnahmen zu erkennen – eine Leistung, die in ihrer Schnelligkeit und Mustererkennungskompetenz durchaus mit medizinischer Intuition vergleichbar ist (vgl. Esteva et al., 2017). In dieser Hinsicht lässt sich die unbewusste, aber treffsichere Komponente menschlicher Intuition durch KI zumindest funktional simulieren.

Erfahrungswissen und heuristisches Entscheiden

Gerd Gigerenzer (2007) hebt hervor, dass Intuition nicht beliebig oder irrational sei, sondern auf unbewusster Intelligenz beruhe – einem Erfahrungswissen, das durch Wiederholung, Feedback und situatives Lernen entsteht. Auch moderne KI nutzt Erfahrung in Form von Daten, etwa beim maschinellen Lernen oder Reinforcement Learning. Dadurch können KI-Modelle Regeln entwickeln, die jenen heuristischen Entscheidungsstrategien ähneln, wie sie auch der Mensch im Alltag verwendet (z. B. die „Take-the-best“-Heuristik).

Allerdings ist dieses Erfahrungslernen bei KI nicht mit menschlicher Erfahrung gleichzusetzen: Menschliche Intuition ist verkörpert („embodied“), emotional eingebettet und kontextsensitiv – Eigenschaften, die KI nicht in vollem Umfang reproduzieren kann. Sie lernt aus Daten, nicht aus Erleben.

Emotionale und moralische Intuitionen: Die Grenzen der KI

Ein entscheidender Unterschied zwischen KI und menschlicher Intuition liegt im Bereich des affektiv-emotionalen und moralischen Urteilens. Nach Antonio Damasio (1994) basieren intuitive Entscheidungen zu einem erheblichen Teil auf sogenannten „somatischen Markern“ – körperlich empfundene Signale, die emotionale Reaktionen mit bestimmten Handlungsoptionen verknüpfen. Diese verkörperte Entscheidungsbasis ist für KI grundsätzlich unzugänglich. Maschinen verfügen weder über einen Körper im biologischen Sinne noch über subjektives Empfinden. Sie können Gefühle simulieren, nicht jedoch erleben.

Auch im Bereich moralischer Intuitionen – etwa beim Erkennen von sozialer Ungerechtigkeit oder moralischem Fehlverhalten – stößt KI an fundamentale Grenzen. Jonathan Haidt (2001) argumentiert, dass moralische Urteile primär intuitiv getroffen werden und erst im Nachhinein rationalisiert werden. Während KI normative Entscheidungsmodelle (z. B. utilitaristische Abwägungen) berechnen kann, fehlt ihr ein Gewissen, ein Wertebewusstsein und das Vermögen zur Empathie. Damit bleibt sie auf formalisierbare Aspekte moralischen Handelns beschränkt und kann keine authentischen moralischen Intuitionen entwickeln.

Komplexität, Unsicherheit und Kontextsensitivität

In hochkomplexen und dynamischen Entscheidungssituationen – wie etwa bei Naturkatastrophen, militärischen Konflikten oder medizinischen Notfällen – ist menschliche Intuition häufig der rationalen Analyse überlegen. Das liegt unter anderem an ihrer Fähigkeit zur ganzheitlichen Wahrnehmung, Mustererkennung in instabilen Umgebungen und situationsgerechtem Handeln unter Zeitdruck. Zwar entwickeln KI-Modelle zunehmend adaptive Fähigkeiten, doch fehlt ihnen bisher ein echtes „situational awareness“ – ein kontextgebundenes, erfahrungsbasiertes Verständnis, das über bloße Datenanalyse hinausgeht (vgl. Klein, 1998).

Künstliche Intelligenz kann bestimmte Funktionen der menschlichen Intuition – insbesondere schnelle Mustererkennung, erfahrungsbasiertes Lernen und heuristische Entscheidungsstrategien – mit hoher Effizienz simulieren. In streng formalisierten Kontexten übertrifft KI die menschliche Intuition sogar an Präzision und Geschwindigkeit. Dennoch bleiben zentrale Dimensionen intuitiver Urteilsbildung – wie emotionale Resonanz, verkörperte Erfahrung und moralische Empfindsamkeit – für Maschinen unzugänglich. Intuition im umfassenden Sinne bleibt damit ein genuin menschliches Phänomen. Die Zukunft intelligenter Systeme wird daher weniger im Ersatz, sondern im Zusammenspiel von algorithmischer Logik und menschlicher Intuition liegen.